AI e storie sociali: come usarla in modo etico e consapevole nella pratica educativa

Tecnologia educativa e bisogni speciali: in che modo l’intelligenza artificiale può supportare insegnanti, educatori e terapisti senza sostituirli

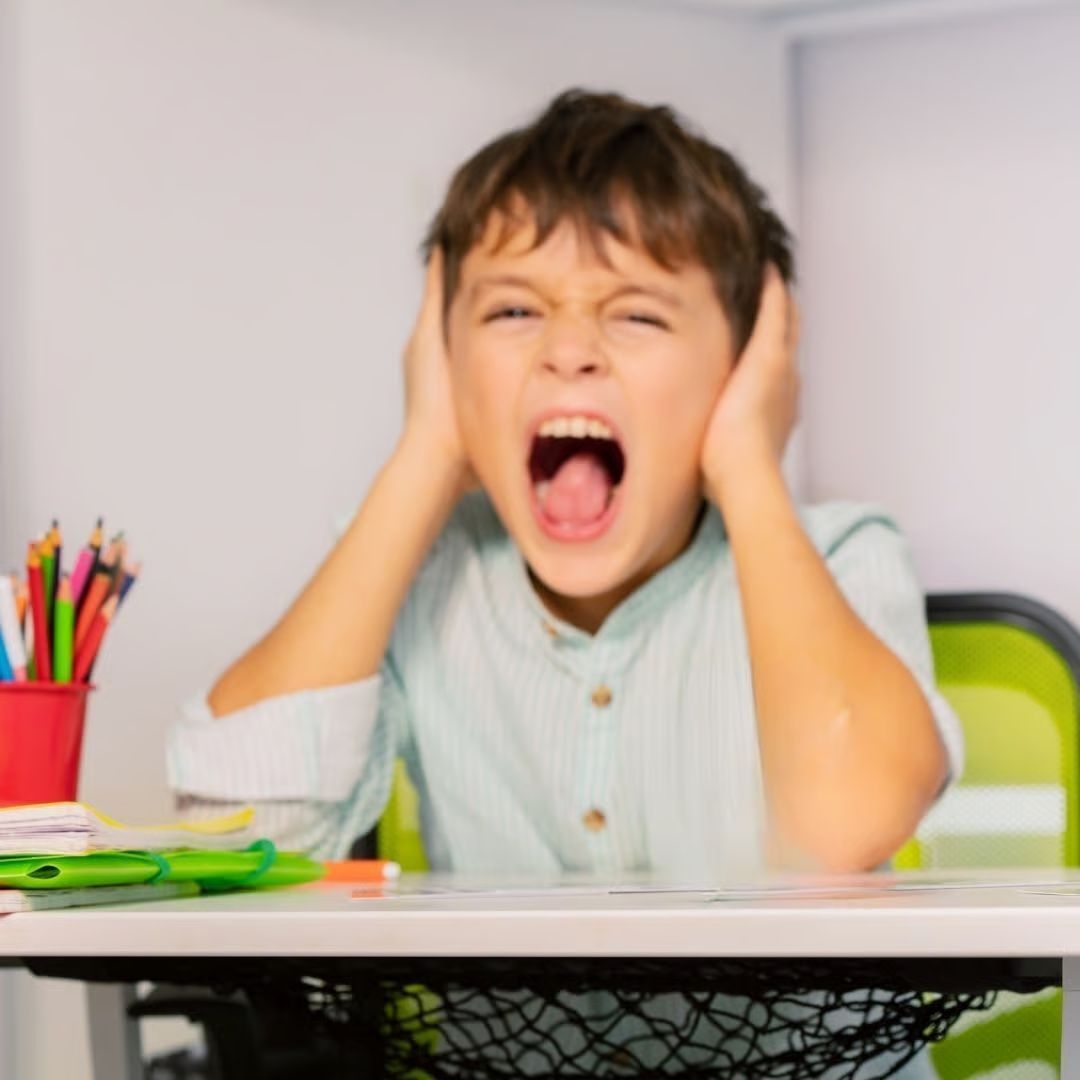

Quando il tempo non basta e la qualità rischia di calare

Se lavori come insegnante di sostegno, educatore o terapista, probabilmente conosci bene questa scena.

È sera.

Hai ancora documentazione da aggiornare, programmazioni da rivedere, materiali da preparare.

Nel frattempo una famiglia aspetta una storia sociale personalizzata per aiutare il bambino a gestire l’ansia prima di una visita medica, di una gita o di un cambiamento importante.

Sai che quella storia dovrebbe essere calibrata con attenzione:

- linguaggio semplice,

- prospettiva rassicurante,

- assenza di ambiguità,

- struttura prevedibile.

Ma il tempo è poco.

Ed è proprio qui che molti professionisti iniziano a chiedersi:

l’intelligenza artificiale può davvero aiutarmi?

Non per sostituire la competenza educativa.

Ma per alleggerire il carico tecnico iniziale.

L’intelligenza artificiale sta entrando anche nell’educazione inclusiva

Negli ultimi anni l’AI generativa ha iniziato a essere utilizzata in diversi ambiti della progettazione educativa: semplificazione linguistica, supporti visivi, adattamento di materiali, prime bozze narrative.

Anche nel campo delle storie sociali questa tecnologia sta attirando crescente interesse perché consente di velocizzare una fase che, tradizionalmente, richiede molto tempo di scrittura e riformulazione.

La letteratura più recente evidenzia infatti come i sistemi AI possano supportare la produzione di contenuti educativi personalizzabili, purché resti centrale la supervisione professionale umana.

La domanda, quindi, non è tanto se usare o non usare l’AI.

La vera domanda è:

come usarla bene?

Cosa può fare davvero l’AI nella creazione di storie sociali

Un sistema di intelligenza artificiale generativa può aiutare a:

- creare una prima bozza coerente,

- adattare il linguaggio a diverse età,

- riformulare frasi per renderle più chiare,

- organizzare una sequenza narrativa logica,

- suggerire passaggi rassicuranti e prevedibili.

Questo significa ridurre in modo significativo il tempo della pagina bianca.

Esempio concreto

Un educatore deve preparare una storia sociale per:

Marco, 7 anni, autismo, forte difficoltà con i cambi di routine, ansia quando l’insegnante è assente.

Un generatore AI può produrre rapidamente una struttura iniziale che includa:

- cosa succede quando l’insegnante non c’è,

- chi sarà presente,

- cosa rimane uguale,

- quali emozioni posso sentire,

- quali strategie mi aiutano.

Ed è esattamente in questa direzione che nascono strumenti specifici come EduStories AI, progettati non come semplici chatbot generici ma come generatori guidati focalizzati sulle esigenze reali delle storie sociali educative.

Tuttavia questa è solo la base.

Cosa l’AI non può fare (e non deve fare)

Qui sta il punto più importante.

L’intelligenza artificiale non conosce il bambino.

Non osserva i segnali sottili.

Non interpreta la qualità della regolazione emotiva.

Non percepisce il tono relazionale.

Non sa che una singola parola può essere rassicurante per un bambino e attivante per un altro.

La personalizzazione vera nasce da:

- osservazione,

- esperienza clinico-educativa,

- conoscenza del contesto,

- confronto con famiglia e team.

L’AI non può assumersi questa responsabilità.

Può organizzare.

Può suggerire.

Può accelerare.

Ma non può sostituire il giudizio professionale.

Perché la questione etica è centrale

Quando si parla di AI e bisogni educativi speciali entrano in gioco aspetti delicati:

- privacy dei dati,

- sensibilità delle informazioni inserite,

- qualità dei contenuti generati,

- trasparenza verso le famiglie.

Un utilizzo etico dell’AI significa:

✔ non inserire dati identificativi sensibili

✔ revisionare sempre il testo prodotto

✔ non delegare decisioni educative

✔ considerare l’AI uno strumento e non un’autorità

Questo è un passaggio fondamentale.

Perché il rischio non è usare l’AI.

Il rischio è usarla in modo acritico.

Le principali linee guida internazionali sull’AI educativa insistono proprio su supervisione umana, accountability e protezione dei dati nei contesti vulnerabili.

Cambio di prospettiva: da sostituto ad assistente

L’errore più comune è pensare:

“se l’AI scrive la storia, il problema è risolto.”

In realtà il paradigma utile è un altro:

l’AI prepara una bozza, tu resti l’autore.

È una differenza sostanziale.

Significa vedere la tecnologia come:

- supporto di struttura,

- supporto di linguaggio,

- supporto di velocità.

Ma la responsabilità narrativa e pedagogica rimane umana.

Ed è questa distinzione che protegge la qualità educativa.

Un utilizzo realistico e sostenibile nella pratica quotidiana

In molte scuole e servizi educativi il problema non è capire se le storie sociali siano utili.

Il problema è riuscire a produrle con continuità.

Qui l’AI può diventare un alleato organizzativo per:

- creare prime bozze,

- adattare storie già esistenti,

- velocizzare revisioni linguistiche,

- modificare situazioni ricorrenti.

Il risultato non è “meno professionalità”.

Il risultato è: meno tempo sulla struttura tecnica e più tempo sull’osservazione e sulla relazione.

Tecnologia, quindi, come tempo restituito alla persona.

È la filosofia alla base anche di EduStories AI: non automatizzare il lavoro educativo, ma alleggerire la fase più dispersiva della costruzione.

Conclusione — l’AI non è una scorciatoia, ma può essere un supporto concreto

L’intelligenza artificiale non è una soluzione magica.

Non è una sostituzione.

E non è una delega.

Ma può diventare un supporto concreto se utilizzata con:

- consapevolezza,

- supervisione professionale,

- attenzione etica,

- centralità umana.

Le storie sociali restano uno strumento profondamente relazionale.

E la relazione non può essere automatizzata.

Può però essere sostenuta da strumenti che rendono il processo più sostenibile.

Se vuoi approfondire il tema delle storie sociali e del loro utilizzo consapevole, nel blog EduStories trovi altri articoli dedicati a personalizzazione, pratica educativa e strategie operative.

Puoi anche iscriverti alla newsletter EduStories per ricevere riflessioni pratiche e strumenti utili per il lavoro quotidiano.

Le riflessioni proposte in questo articolo si basano sulle più recenti linee guida internazionali relative all’uso etico dell’intelligenza artificiale nei contesti educativi inclusivi.

Riferimenti

Linsenmayer, E. (2025). Leveraging Artificial Intelligence to Support Students with Special Education Needs. OECD Artificial Intelligence Papers, No. 46. OECD Publishing.

https://doi.org/10.1787/1e3dffa9-en

UNESCO (2025). AI and Education: Protecting the Rights of Learners.

https://www.unesco.org/en/articles/ai-and-education-protecting-rights-learners

Varsik, S., & Vosberg, L. (2024). The Potential Impact of Artificial Intelligence on Equity and Inclusion in Education. OECD Artificial Intelligence Papers, No. 23. OECD Publishing.

https://doi.org/10.1787/15df715b-en

Pagliara, S. M., Bonavolontà, G., Pia, M., Falchi, S., Zurru, A. L., Fenu, G., & Mura, A. (2024).The Integration of Artificial Intelligence in Inclusive Education: A Scoping Review. Information, 15(12), 774.

https://doi.org/10.3390/info15120774

Holmes, W., Porayska-Pomsta, K., Nemorin, S., et al. (2024).

The Ethics of AI in Education.

https://arxiv.org/abs/2406.11842

Sharples, M. (2023).Towards Social Generative AI for Education: Theory, Practices and Ethics.

https://arxiv.org/abs/2306.10063

Favero, L., Pérez-Ortiz, J. A., Käser, T., & Oliver, N. (2026).AI in Education Beyond Learning Outcomes: Cognition, Agency, Emotion, and Ethics.

https://arxiv.org/abs/2602.04598

Miao, F., Holmes, W., Huang, R., & Zhang, H. (UNESCO framework referenced in current UNESCO AI education guidelines).Artificial Intelligence and Education: Guidance for Policy-makers.

Read other posts